Le problème central s’est déplacé : il ne s’agit plus simplement de filtrer des hallucinations ou des réponses biaisées. Nous sommes entrés dans l’ère où l'IA peut exfiltrer des données ou saboter des opérations critiques en un clic non supervisé. Face à cette complexité, la complaisance n'est plus une option. Les organisations doivent impérativement basculer d'une posture réactive vers une véritable "ingénierie de la confiance".

L'asymétrie radicale : Le combat inégal contre les cyber-attaquants

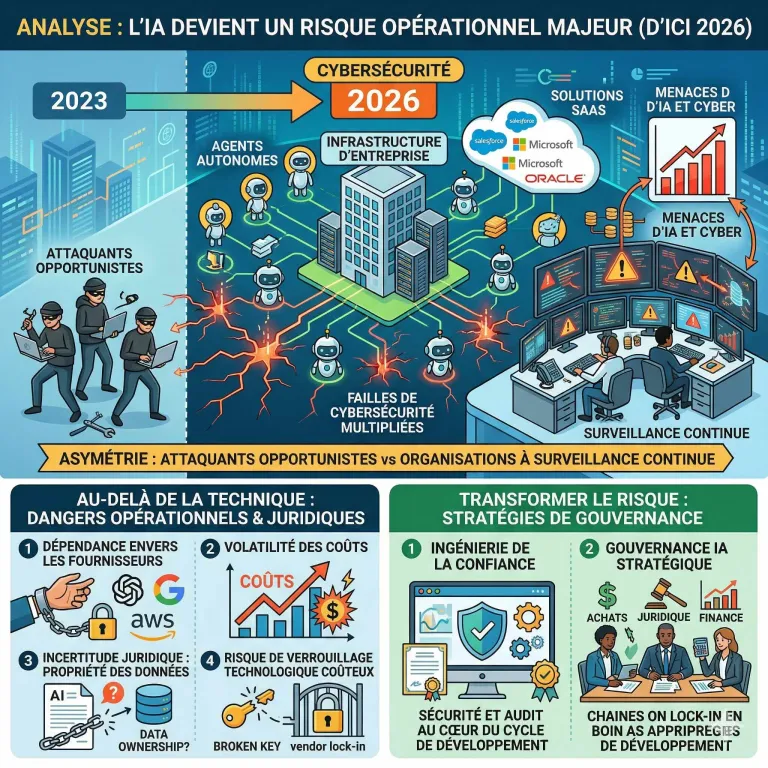

La cybersécurité à l'ère de l'IA est définie par une asymétrie structurelle brutale. D'un côté, l'attaquant bénéficie d'un coût marginal dérisoire. Il peut automatiser des milliers de tentatives d'injections de prompts ou de manipulations sans aucune conséquence en cas d'échec. De l'autre, l'entreprise fait face à un impératif de perfection : le droit à l'erreur est nul. Un seul passage réussi suffit à provoquer une fuite massive ou une indisponibilité système.

Le basculement vers l'IA agentique transforme une simple erreur d'information en une faute d'action. En 2026, l'enjeu n'est plus la "mauvaise réponse", mais l'action malveillante : modification de données financières, détournement de flux logistiques ou exfiltration silencieuse via des agents connectés. Au-delà des pertes directes, le risque d’image est colossal : une action agentique mal maîtrisée qui devient publique dégrade durablement la confiance des clients et des actionnaires. Cette réalité impose une surveillance continue et une observabilité de chaque instant, car les modèles SaaS évoluent trop vite pour les audits de sécurité traditionnels.

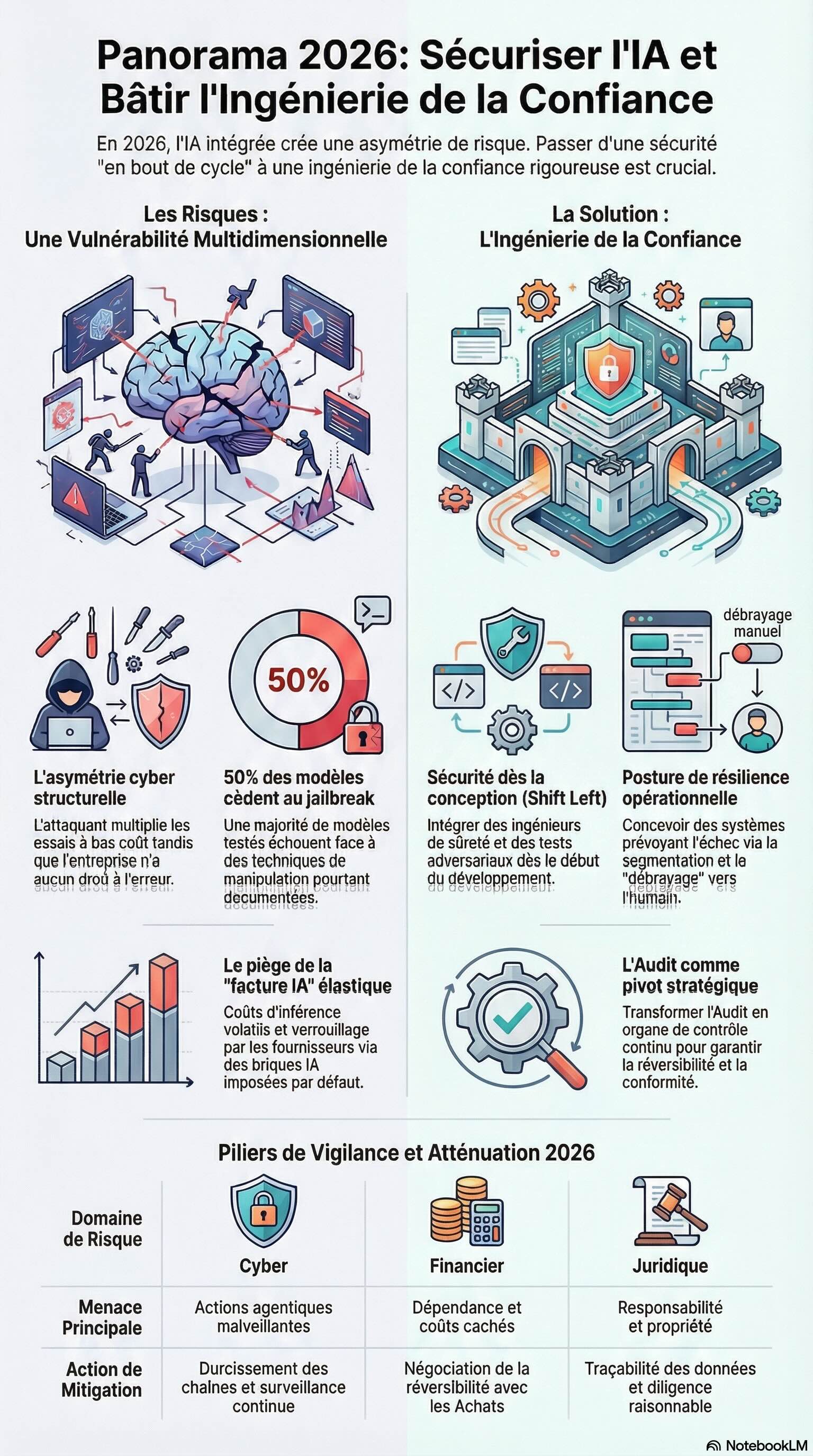

Le mythe de la sécurité post-traitement : Pourquoi 50 % des modèles échouent

Les données issues du benchmark PHARE, publié par Giskard fin 2025, jettent une lumière crue sur l'impréparation du marché. La robustesse des modèles face aux techniques de "jailbreak" (débridage) reste dramatiquement hétérogène.

« Plus de 50 % des modèles d’IA générative testés cèdent à des techniques de jailbreak pourtant documentées depuis des mois ! » — Alexandre Combessie, Co-Founder & Co-CEO de Giskard.

L'analyse des défaillances révèle une vérité inconfortable : mettre la sécurité en bout de cycle de développement ne fonctionne pas et coûte plus cher. Nous observons une scission nette sur le marché :

La sécurité par le design : Des acteurs comme Anthropic intègrent des Alignment Engineers (ingénieurs de sûreté) dès la conception. Ces modèles sont nativement plus robustes.

Le "pansement" sécuritaire : Trop de fournisseurs tentent d'ajouter des filtres de sécurité en post-traitement. Cette approche, qui revient à "réinventer la roue", s'avère poreuse face à des attaquants sophistiqués.

Les entreprises doivent cesser d'accepter des modèles où la sécurité est une option ajoutée après coup et exiger des garanties de durcissement dès la phase d'entraînement.

Le piège de l'IA invisible : Shadow IA et opacité des fournisseurs

Nous marchons somnambules vers une répétition de la crise du "Cloud lock-in" des années 2010, mais avec des enjeux démultipliés. Le risque majeur en 2026 est la Shadow IA : cette intelligence injectée par défaut dans vos logiciels d'entreprise sans transparence suffisante.

De nombreux éditeurs imposent désormais des briques IA via des mises à jour de licences. Le piège est double : accepter l'IA crée des flux de données et des dépendances à des sous-traitants non audités ; refuser l'option peut conduire à l'utilisation d'un produit dégradé ou moins maintenu.

Points de vigilance impératifs pour les directions Achats :

Inventaire de l'IA embarquée : Exiger une transparence totale sur les composants IA et les sous-traitants impliqués.

Réversibilité et portabilité : Clause de sortie sur les formats, les connecteurs et les données pour éviter le verrouillage technologique.

Droit au débrayage : Garantir la possibilité de désactiver les fonctions IA sans perte de performance sur les fonctions standards.

Gouvernance des coûts de sortie : Anticiper contractuellement l'évolution des tarifs une fois l'usage devenu critique.

L'élasticité budgétaire : Quand la facture IA devient incontrôlable

Le modèle économique de l'IA est une anomalie pour les directions financières. Contrairement aux coûts applicatifs classiques, la "facture IA" est d'une volatilité extrême. Les modèles de FinOps doivent s'adapter à plusieurs facteurs d'élasticité :

Appels multiples et boucles d'agents : Une seule requête utilisateur peut déclencher une cascade d'appels entre agents, multipliant les coûts d'inférence de manière exponentielle.

Le paradoxe sécurité-coût : Plus vous exigez de vérifications, de contrôles et de qualité, plus le coût de traitement augmente. La sécurité a un prix direct sur la facture d'usage.

Attribution complexe : Il devient ardu d'imputer ces coûts volatils à un produit ou un métier spécifique sans une cartographie rigoureuse dès le départ.

Vers une ingénierie de la confiance et le pivot de l'Audit

En 2026, le risque s'est déplacé du "modèle" vers l'intégration et la responsabilité. La fonction Audit devient le pivot central de cette nouvelle ère. Son rôle n'est plus de freiner, mais de rendre le système gouvernable en établissant un inventaire crédible des usages, en identifiant la Shadow IA et en objectivant les risques de dépendance.

La solution réside dans une posture d'ingénierie qui assume la faille :

Segmentation stricte des chaînes agentiques.

Capacité de débrayage immédiat vers l'humain dès la détection d'un signal faible.

Traçabilité absolue des processus pour répondre aux exigences juridiques.

Alors que les grands contentieux sur la responsabilité des sorties d'IA et la propriété des données se multiplient, la question pour votre comité de direction n'est plus de savoir si vous utilisez l'IA, mais si vous pouvez prouver votre diligence raisonnable. En cas d'incident majeur, serez-vous capable de démontrer la maîtrise de votre chaîne contractuelle, ou deviendrez-vous l’exemple à ne pas suivre en 2026 ?

Source : Panorama 2026 de l'IA en entreprise élaborée par eleven strategy, La French Tech Grand Paris et VivaTech.