La grille de lecture "Sense, Plan, Act" : Comprendre le cerveau et les muscles

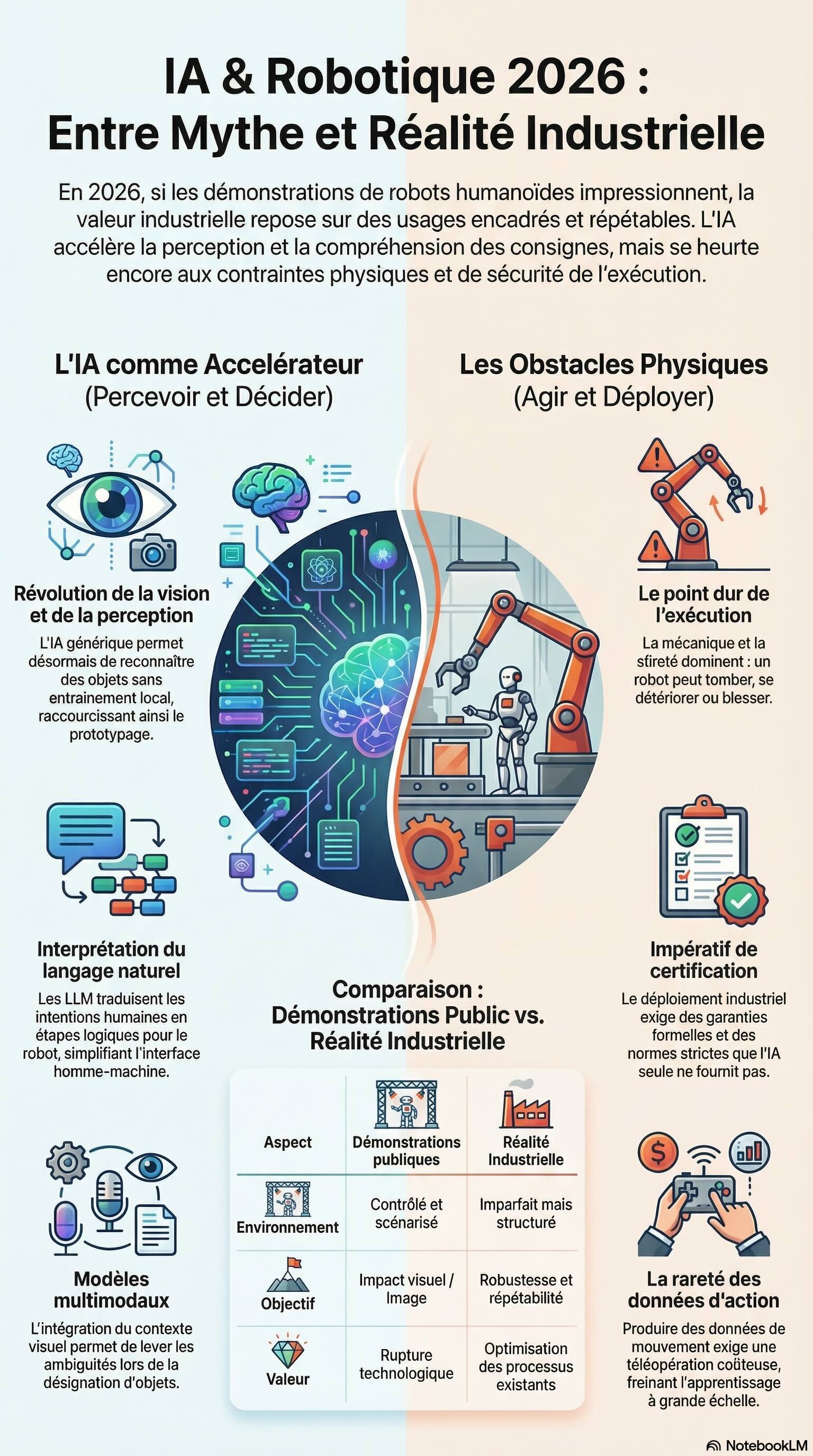

Pour déchiffrer les avancées actuelles, il est indispensable de revenir au triptyque fondamental de la robotique : Percevoir (Sense), Décider (Plan), Agir (Act). Ce cadre conceptuel permet de comprendre pourquoi l’IA ne progresse pas à la même vitesse sur tous les fronts :

Perception (Sense) : La conversion des signaux bruts (caméras, LiDAR, capteurs de force) en informations exploitables. C'est ici que l'IA excelle, identifiant objets et géométries avec une acuité sans précédent.

Décision (Plan) : L'interprétation d'une consigne pour la décomposer en étapes cohérentes. On passe ici d'une programmation rigide à une compréhension sémantique de l'intention.

Action (Act) : L'exécution physique via des boucles de commande bas niveau. C'est le royaume de la dynamique, de la stabilité et de la sûreté, où chaque mouvement doit être maîtrisé au millimètre près.

En 2026, le paradoxe est frappant : le "cerveau" et les "sens" du robot sont devenus ultra-performants grâce aux modèles de fondation, mais les "muscles" restent bridés par des impératifs de sécurité et de certification.

Le triomphe de la perception et du langage : La fin des ontologies rigides

L'accélération la plus spectaculaire concerne la vision et l'interface homme-machine. Nous avons quitté l'ère où il fallait collecter et annoter des milliers d'images localement pour apprendre à un robot à reconnaître un objet spécifique.

Aujourd'hui, l'usage de modèles open source robustes pour la segmentation et la détection offre un socle exploitable immédiatement lors de l'intégration. Les gains sont majeurs :

Décomposition naturelle des tâches : Les Large Language Models (LLM) ont remplacé les ontologies formelles coûteuses. Ils traduisent une instruction naturelle en une suite d'étapes plausibles, agissant comme un chef d'orchestre entre l'intention humaine et les briques logicielles préexistantes.

Ancrage multimodal : Les modèles capables de lier texte et vision permettent de lever instantanément les ambiguïtés spatiales (« ramasse la boîte rouge à gauche »).

Agilité du prototypage : La fin de l'entraînement spécifique pour chaque nouvel objet réduit drastiquement les cycles de mise en œuvre en entreprise.

L'exécution physique : Le mur de la réalité et de la sûreté

Si l’IA peut planifier une action avec brio dans un monde numérique, l’exécution dans le monde physique reste le "point dur". Un logiciel pur ne peut pas tomber ; un robot, si. Sur un humanoïde, une simple perte d'équilibre peut entraîner des coûts de réparation prohibitifs et des arrêts de production.

« En robotique, la question n’est pas ce que le système sait faire, mais ce qu’il peut faire de façon sûre, reproductible et certifiable. » — Serena Ivaldi, Directrice de Recherche Inria et Co-fondatrice de Bleu Robotics.

Cette exigence de sûreté crée une friction stratégique : les industriels rechignent à remplacer des boucles de commande bas niveau (low-level control loops), éprouvées et déterministes, par des modèles d'IA de type "boîte noire" dépourvus de garanties formelles. En 2026, l'IA est donc massivement déployée comme une couche d'intelligence supérieure, mais elle reste bridée par des garde-fous explicites qui pilotent l'exécution finale.

Les trois barrières invisibles du passage à l'échelle

Le déploiement massif de l'IA physique se heurte à trois obstacles structurels que le marketing des start-ups occulte souvent :

Certification et conformité : Contrairement à un chatbot, un robot industriel doit répondre à des normes de sécurité machine strictes. L'absence de prédictibilité totale des modèles d'apprentissage profond rend leur certification complexe sans l'ajout de couches de contrôle traditionnelles.

La "gratuité" illusoire : L'apparente facilité d'accès aux modèles open source masque les investissements massifs en infrastructure nécessaires. Pour les entreprises, cela crée une asymétrie et une dette stratégique vis-à-vis des géants qui développent les briques fondamentales.

La rareté des données d'action : Si l'IA du langage a bénéficié de tout le Web, l'IA du mouvement manque de données. Leur production via la téléopération est lente et coûteuse, avec un taux de rebut élevé lors de la curation : une grande partie des données collectées est inexploitable pour un apprentissage de qualité.

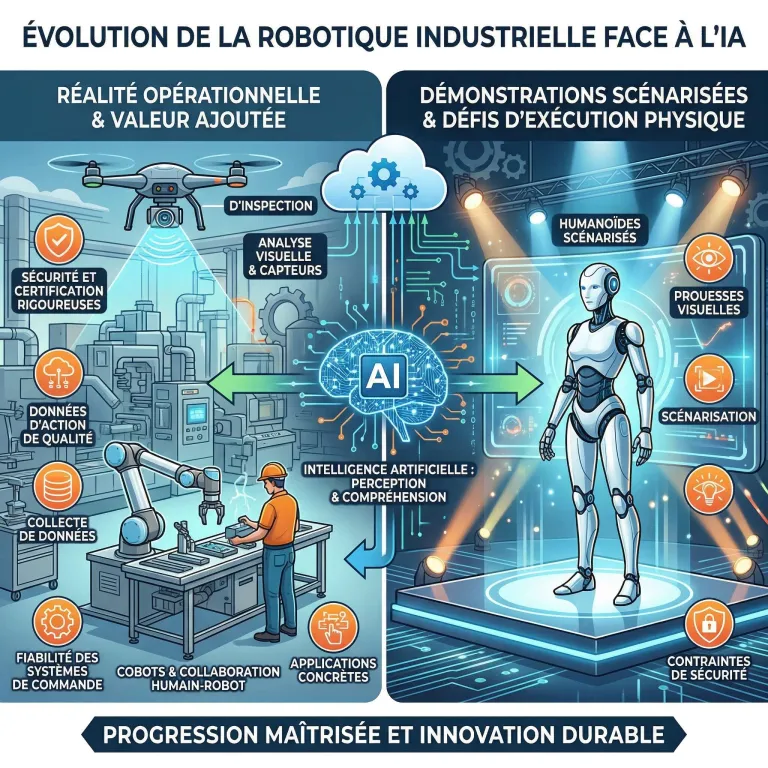

La valeur immédiate : Une robotique pragmatique et segmentée

En 2026, la valeur ajoutée ne se trouve pas dans la polyvalence fantasmée, mais dans la spécialisation efficace. Le succès industriel passe par la structuration et la segmentation de l'environnement pour maximiser les capacités de l'IA.

Les applications qui génèrent aujourd'hui un ROI mesurable incluent :

L'inspection autonome par drones et systèmes de vision industrielle haute précision.

Les robots quadrupèdes pour la surveillance et l'exploration en zones hostiles ou risquées.

Le contrôle d'inventaire automatisé en entrepôts logistiques.

La cobotique collaborative sur les lignes de production.

La robotique agricole spécialisée, capable de traiter chaque plante individuellement.

Vers une IA physique maîtrisée

L'horizon 2026 dessine une trajectoire de maturité : nous sortons de l'ère de la démonstration spectaculaire pour entrer dans celle de l'intégration robuste. L'Europe, et la France en particulier, disposent d'un avantage compétitif critique dans ce paysage. Notre excellence en ingénierie et notre culture historique de la sûreté industrielle sont des atouts majeurs pour concevoir cette "IA physique" certifiable que le marché réclame.

Le défi ne consiste plus à rendre le robot impressionnant sur vidéo, mais à rendre ses capacités répétables et mesurables. En s'appuyant sur des outils de simulation plus réalistes et un outillage logiciel mature, la robotique de cette décennie prépare le terrain pour une automatisation responsable.

À mesure que l'IA s'incarne dans la matière, saurons-nous maintenir l'équilibre entre l'audace de l'innovation et l'impératif de la maîtrise industrielle ?

-thumb.webp)